Coral AcceleratorとRaspberry Pi3でビデオストリームから物体認識

昨日の続きをやります。

Coralのセットアップは昨日の記事を参考してください。

今日はこれの続きをやろうかな、ビデオからオブジェクト認識など https://t.co/LLTqvSgAt7

— 機械学習・深層学習・Python・Web、IoT (@kokensha_tech) 2019年5月15日

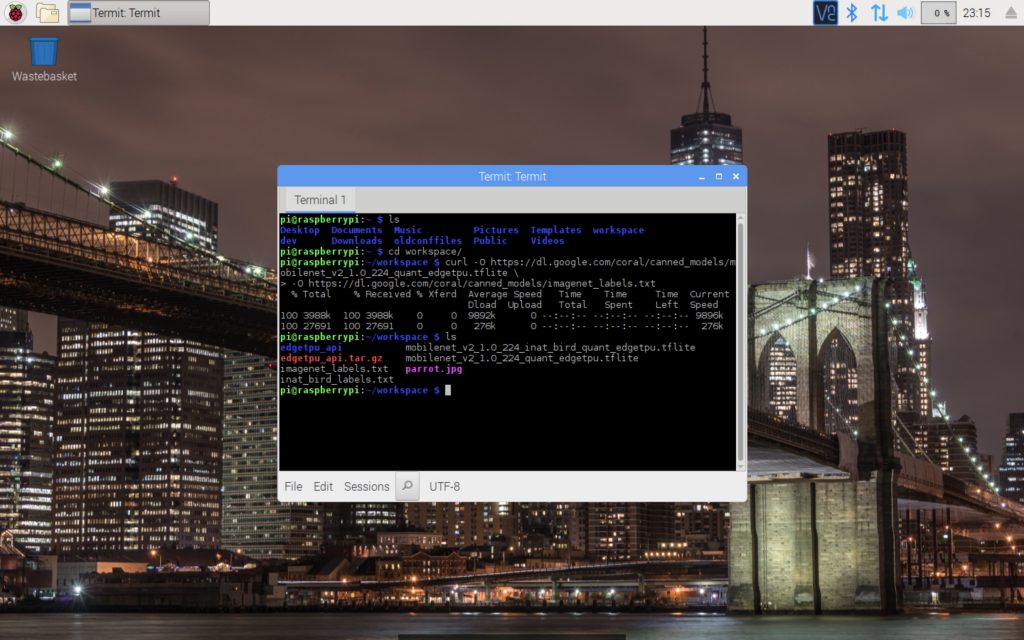

必要な学習済みモデルのダウンロード

curl -O https://dl.google.com/coral/canned_models/mobilenet_v2_1.0_224_quant_edgetpu.tflite \ -O https://dl.google.com/coral/canned_models/imagenet_labels.txt

次は、demoのディレクトリに移動します。

cd /usr/local/lib/python3.5/dist-packages/edgetpu/demo

次は、picameraのPythonモジュールをインストールします。すでにインストール済みの場合は、このステップスキップして良いです。

pip3 install picamera

次はPythonプログラムを起動します。

python3 classify_capture.py \ --model ~/workspace/mobilenet_v2_1.0_224_quant_edgetpu.tflite \ --label ~/workspace/imagenet_labels.txt

結果はこちらです。

画面が縦になって、すみません。

認識のスピードがとても早いです。応用によっては十分なパーフォマンスができるかと思われます。

まとめ

短い記事となりましたが、実際に、ハードウェアもソフトウェアも用意されていれば、やることは本当にこれしかないです。

もちろん、何か物体を認識したら、〇〇アクションをするという部分は自分の応用に合わせて開発する必要があるかと思います。

また、今までは学習済みのもデールをそのまま使いましたが、自分の応用では独自の認識させたいものがあるかもしれません

その場合、移転学習の手段が可能なので、次回の記事はそれをトピックにしてみたいと思います。

以前も物体認識の類の記事がありますので、合わせてお読みください。

[amazonjs asin=”4873117585″ locale=”JP” title=”ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装”]

[amazonjs asin=”B07QQ9CFNP” locale=”JP” title=”NVIDIA Jetson Nano Developer Kit – 強力 AI コンピュータ 開発者キット”]